1. 1本のスクリプトによる運用の課題

データエンジニアリングにおいて、Pythonなどのスクリプト1本で「データの抽出、加工、ロード」のすべてを行う手法は、初期段階では効率的です。しかし、システムの規模が広がるにつれて、以下のような課題に直面しやすくなります。

- 修正時の影響範囲の特定: 1箇所の修正が全体のどこに影響するのか、コードを読み解くまで把握が難しくなります。

- エラー発生時の切り分け: 異常が起きた際、それが「接続先の不具合」なのか「集計ロジックのミス」なのかの判断に時間がかかります。

- リカバリの柔軟性: 処理の途中で失敗した際に、特定の手順から再開することが難しく、最初からやり直す運用になりがちです。

本記事では、Google Cloudの各サービスを組み合わせ、「全体の流れを制御する仕組み」と「データの変換を行う仕組み」を分ける設計アプローチについて解説します。

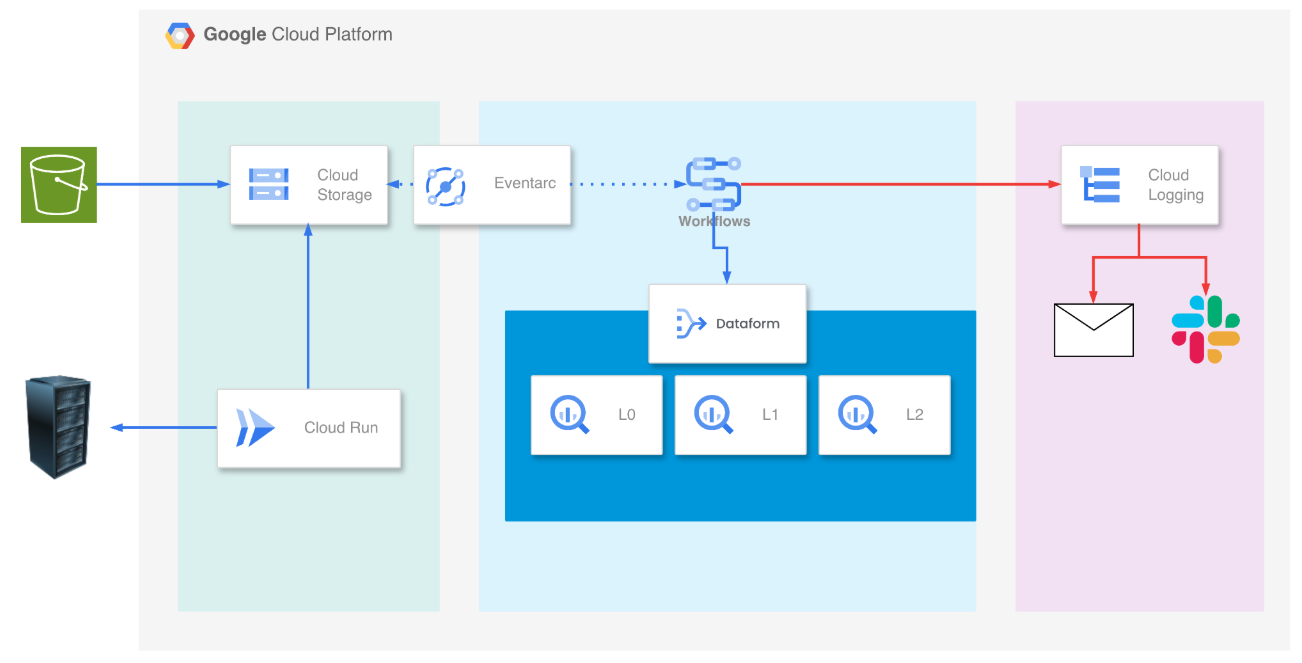

2. アーキテクチャの全体像と各機能の役割

この構成では、各サービスに特定の役割を持たせ、システム全体の複雑さを抑えます。

- GCS (Storage): データをそのままの形で保管し、処理の起点とします。

- Eventarc (Trigger): ファイルの到着を検知し、後続の処理へ通知します。

- Workflows (Orchestration): 処理の実行順序や、異常時のフローを制御します。

- Cloud Functions (Processing): ファイル形式の変換など、SQLでは対応が難しい前処理を担います。

- Dataform (Transformation): BigQuery内でのデータの依存関係と加工処理を管理します。

💡 議論のテーマ:データの入り口(Push型 vs Pull型)

Q. クライアントが GCS にデータを置く(Push型)場合と、データ基盤側が外部APIにデータを取りに行く(Pull型)場合、設計にはどのような違いが生まれるでしょうか?

検討のヒント:実行のきっかけ(Eventarc か Cloud Scheduler か)、認証情報の管理場所、外部システムへの負荷考慮、責任の境界線がどこにあるかといった視点で考えてみましょう。

3. オーケストレーションとデータ処理の分離

この設計のポイントは、フロー制御(Workflows)とデータ処理(Dataform)の役割を明確に分けることにあります。

全体の制御:Workflows

- どの手順で、どの順番に処理を進めるかを管理します。

- Dataform の実行をリクエストし、その完了を待機(ポーリング)して次のステップへ進みます。

- エラーが起きた際のリトライや、通知の判断を行います。

データの加工:Dataform

- BigQuery 内にあるデータをどのように集計・加工するかを定義します。

- テーブル同士の参照関係や、データに不備がないかのチェック(Assertions)を行います。

- 「いつ実行されるか」というタイミングについては、上位の制御層に任せます。

💡 議論のテーマ:前処理の適切な場所

Q. 文字コードの変換や複雑なデータのクレンジングが必要な場合、Cloud Functions で行うのが良いでしょうか。それとも、まずは BigQuery に取り込んでから SQL で解決すべきでしょうか?

検討のヒント:インフラの実行コスト、開発やデバッグのしやすさ、データ量への対応力といった観点で比較してみましょう。

4. 運用の柔軟性と監視の仕組み

再利用性の高い仕組みづくり

Dataform の完了を待機する処理などは、Workflows の「サブワークフロー」として共通化しておくことで、他のパイプラインでも同じ仕組みを使い回すことが可能になります。

実行パラメータの活用

Dataform にコンパイル変数(vars)を渡すことで、通常時は「当日のデータのみ更新」、リカバリ時は「過去の特定期間を再計算」といった切り替えを、コードを修正せずに実現できます。

💡 議論のテーマ:同時実行への対応

Q. ファイルが同時に多数届いた場合、Workflows が同時に多数起動することになります。この時、BigQuery の実行制限などにどのような影響が出るでしょうか?

検討のヒント:並列実行数の制限方法や、一定時間待機してまとめて処理する(バッチ化)といった対策について考えてみましょう。

監視と通知

Cloud Logging を活用し、処理の状況やエラーの内容を構造化されたログとして出力します。これにより、問題が起きた際に「どのような入力値で失敗したか」を素早く特定できます。

💡 議論のテーマ:通知の設計

Q. エラー時の通知は、Workflows の処理の中に組み込むべきでしょうか。それとも Cloud Logging のログを監視して外部から通知を飛ばすべきでしょうか?

検討のヒント:メンテナンスのしやすさや、システム全体が停止した際にどちらが確実に通知できるかといった視点で考えてみましょう。

5. 設計アプローチのメリット

- 変更への対応力: フローを変更したい場合は Workflows、集計ロジックを変えたい場合は Dataform と、修正箇所が限定されます。

- 時間の有効活用: イベント駆動を採用することで、データが届き次第すぐに処理を開始でき、全体の完了時間を早めることができます。

- リカバリの確実性: GCS に元のデータが残っているため、ロジックに不備が見つかっても、過去に遡って正確に再計算することが容易になります。

まとめ

Google Cloud の各サービスには、それぞれ適した役割があります。これらを役割ごとに組み合わせて構成することで、変更に強く、状況把握がしやすいデータパイプラインを構築できます。

スクリプト1本で完結させる手法と比較すると、初期の設計には少し時間がかかるかもしれませんが、長期的な運用の安定性を考える上で、こうした「役割の分離」は有効なアプローチであると考えています。